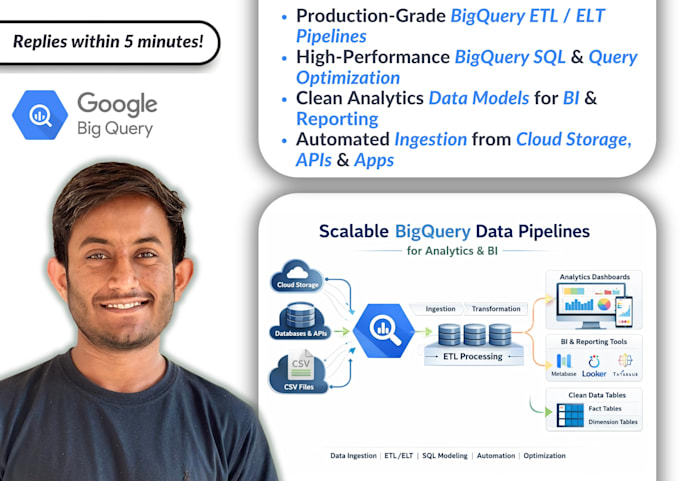

Ich werde BigQuery-Datenpipelines für Analysen und Berichte erstellen

Dateningenieur: dbt, BigQuery, PySpark, Python, SQL, GCP, AWS

Level 1

Hat bestimmte Leistungskriterien erfüllt und zeigt großes Potenzial auf dem Marktplatz.

Über diesen Service

Wenn deine Daten in BigQuery unordentlich, langsam oder unzuverlässig sind, sind Dashboards und Berichte nutzlos.

Ich kann dir helfen BigQuery-Datenpipelines zu entwerfen, zu bauen und zu automatisieren, die Rohdaten in saubere, analysebereite Tabellen umwandeln, die für Berichte, BI-Tools und Entscheidungen optimiert sind.

Ich konzentriere mich auf Korrektheit, Leistung und Skalierbarkeit, nicht auf schnelle Hacks.

Wobei ich dir helfen kann

Design von BigQuery-Pipelines

End-to-End-ELT/ETL-Pipelines nach Best Practices für BigQuery entwerfen, optimiert für Kosten und Leistung.

Datenaufnahme & Transformation

Daten aus Datenbanken, APIs, CSVs oder Cloud-Speicher laden und mit SQL-basiertem Modeling transformieren.

Geplante & automatisierte Pipelines

Geplante Jobs und inkrementelle Loads einrichten, damit deine Daten stets aktuell sind, ohne manuellen Aufwand.

Datenmodellierung für Analysen

Saubere Fakten- und Dimensionstabellen erstellen, die nahtlos mit BI-Tools wie Metabase, Looker oder Tableau funktionieren.

Query-Optimierung & Kostenkontrolle

Abfragen und Tabellenstrukturen optimieren, um BigQuery-Kosten zu senken und die Leistung zu verbessern.

Dokumentation & Übergabe

Klare Dokumentation bereitstellen, damit dein Team den Pipeline versteht und warten kann.