Ich werde einen Python-Web-Scraper mit Selenium oder Beautifulsoup erstellen

Über diesen Service

Automatische Übersetzung

Mehr als 6 Jahre Python-Erfahrung. Über 10 Scraping-Pipelines für Unternehmenskunden umgesetzt.

Ich extrahiere die Daten, die du brauchst, von E-Commerce-Seiten, Verzeichnissen, sozialen Medien, Immobilienanzeigen – was auch immer – und liefere sie sauber und strukturiert.

Tools, die ich verwende:

- BeautifulSoup (schnell, für statische Seiten)

- Selenium / Playwright (für JS-intensive Seiten)

- httpx / aiohttp (für hochleistungsfähiges asynchrones Scraping)

- Rotierende Proxys + User-Agent-Handling bei Bedarf

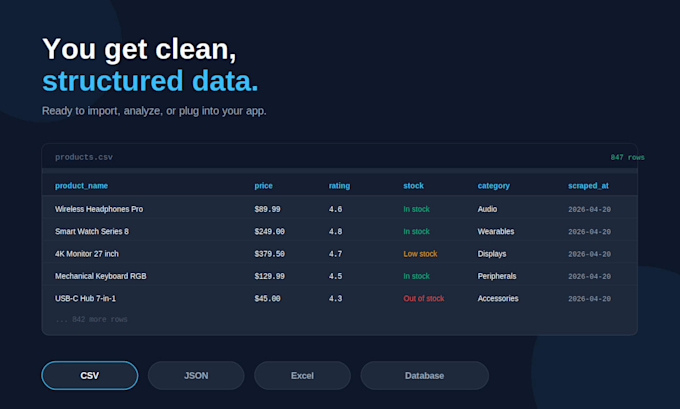

Du bekommst:

- Ein sauberes Python-Skript, das du selbst ausführen kannst

- Strukturierte Ausgabe (CSV, JSON, Excel oder Datenbank)

- Dokumentation zur Nutzung und Anpassung

- Ethisches Scraping (Respektierung der robots.txt, wenn relevant)

Bitte schick mir vor der Bestellung eine Nachricht mit der Ziel-URL, damit ich die Machbarkeit prüfen kann (einige Seiten sind stark geschützt).

Lerne Louis J. kennen

Full Stack Developer

- AusFrankreich

- Mitglied seitApr. 2026

Sprachen

Französisch, Englisch

Automatische Übersetzung

FAQ

Automatische Übersetzung

Was erhalte ich am Ende?

Du erhältst ein sauberes Python-Skript, das du auf deinem Computer oder Server selbst ausführen kannst, sowie die extrahierten Daten im gewünschten Format (CSV, JSON, Excel oder direkt in einer Datenbank). Ich füge eine klare Dokumentation bei, damit du es laufen lassen, anpassen oder planen kannst – ganz ohne meine Hilfe.

Was passiert, wenn sich die Website ändert und der Scraper nicht mehr funktioniert?

Webseiten ändern sich im Laufe der Zeit, was jeden Scraper beeinträchtigen kann. Kleine Anpassungen innerhalb von 14 Tagen nach Lieferung sind kostenlos. Für größere Neugestaltungen oder langfristige Wartung biete ich günstige monatliche Wartungspakete an – schreib mir einfach, um das zu besprechen.

Was mache ich, wenn ich mehr als 100 Seiten brauche?

Kein Problem, meine Pakete umfassen bis zu 100 Seiten, und du kannst die Option "Zusätzliche Seiten, die gescraped werden" hinzufügen, um so viele Seiten zu erfassen, wie du möchtest. Große Projekte mit mehr als 50.000 Seiten sind ebenfalls möglich – schick mir eine Nachricht für ein individuelles Angebot.

Arbeitest du mit login-geschützten oder dynamischen JavaScript-Seiten?

Ja. Ich verwende Selenium und Playwright für JavaScript-intensive Seiten (unendliches Scrollen, dynamische Inhalte, AJAX-geladenen Daten). Für login-geschützte Seiten kann ich mit deinen Zugangsdaten arbeiten, wenn das Scraping für dein eigenes Konto oder eine autorisierte Nutzung ist – niemals, um Zugriffskontrollen auf Seiten zu umgehen, die du nicht besitzt.