Ich passe AI-Agenten, lokale LLMs und RAG-Lösungen in Python an

Über diesen Service

Automatische Übersetzung

Ich baue Sovereign AI Infrastructure-private, lokale und leistungsstarke Systeme, die auf deiner eigenen Hardware laufen, mit keinen API-Kosten.

Als Systemarchitekt spezialisiere ich mich auf den Einsatz von Large Language Models (LLMs) und autonomen Agenten, die Datenhoheit und Privatsphäre priorisieren. Ob du einen privaten Forschungsassistenten oder einen komplexen Multi-Agenten-Workflow brauchst, ich liefere sauberen, produktionsbereiten Code, der für lokale Ausführung optimiert ist.

Was ich anbiete:

- Lokale LLM-Implementierung: Einrichtung von Llama 3, Mistral oder DeepSeek auf deinem lokalen Rechner (optimiert für 8GB+ VRAM).

- Maßgeschneiderte RAG-Pipelines: Chat mit deinen privaten PDFs, CSVs und SQL-Datenbanken unter Verwendung von Vector DBs (ChromaDB/Pinecone).

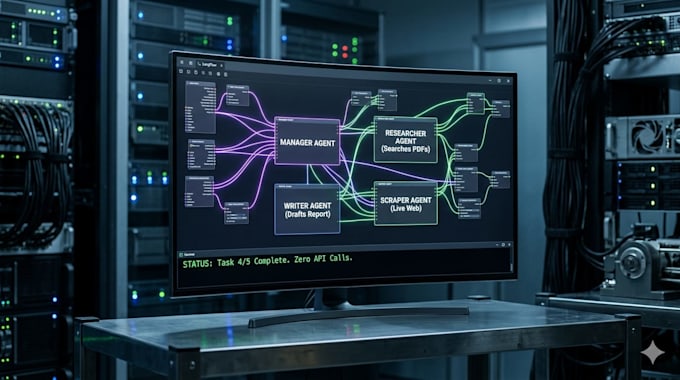

- Autonome AI-Agenten: Mehrstufige Workflows mit CrewAI oder AutoGen zur Handhabung komplexer Geschäftslogik.

- Model-Quantisierung: Optimierung großer Modelle für effizienten Betrieb auf Consumer-Hardware.

- End-to-End-Automatisierung: Python-Skripte, die die Lücke zwischen AI und deinen bestehenden Apps schließen.

Das Ergebnis: Jedes Projekt beinhaltet vollständigen Source Code, eine Docker-Umgebung für die Ein-Klick-Installation und professionelle Dokumentation. Kein Gatekeeping, du besitzt das System, das ich aufbaue.

Hör auf, für Tokens zu bezahlen. Baue deine Festung.

Lerne A.Pulley kennen

Local Intelligence, Total Privacy, Expert AI Solutions

- AusVereinigte Staaten

- Mitglied seitAug. 2025

- ⌀ Antwortzeit2 Tage

Sprachen

Englisch

Automatische Übersetzung

FAQ

Automatische Übersetzung

Was genau ist "Sovereign Ai" und warum brauche ich das?

Sovereign AI bedeutet, deine Intelligenz zu besitzen, anstatt sie zu mieten. Ich baue Systeme, die auf deiner Hardware oder in deiner privaten Cloud laufen. Keine Daten verlassen dein Netzwerk, und du zahlst keine monatlichen API-Gebühren. Es ist totale Kontrolle über deine Daten und deine digitale Zukunft.

Brauche ich einen Server für 10.000 $, um lokale LLMs zu betreiben?

Nein. Mit Quantisierung (GGUF/EXL2) optimiere ich Modelle wie Llama 3, damit sie auf Consumer-Hardware laufen. Eine RTX 3060/4060/5060 mit 8GB VRAM reicht für einen schnellen privaten Assistenten. Ich spezialisiere mich darauf, "schwere" Modelle auf schlanken, effizienten Maschinen laufen zu lassen.

Kann die AI meine privaten Firmendokumente sicher lesen?

Ja. Ich nutze RAG (Retrieval-Augmented Generation), um eine lokale "Vector-Datenbank" zu erstellen. Die AI durchsucht deine PDFs, CSVs oder SQL-Dateien in Echtzeit. Deine Daten verlassen nie dein Netzwerk und werden niemals zum Training öffentlicher Modelle verwendet. Sie bleiben 100% privat.

Was ist der Unterschied zwischen RAG und Fine-Tuning?

RAG ist wie eine "Offene-Buch-Prüfung" – die AI sucht Fakten in deinen Daten. Fine-Tuning ist "Gehirnchirurgie" – es ändert die Persönlichkeit oder Fachsprache der AI. RAG ist am besten für Genauigkeit; Fine-Tuning für eine einzigartige Stimme. Ich biete beides an, um eine vollständige Systemharmonie zu gewährleisten.

Ist das günstiger als ChatGPT Plus oder APIs zu bezahlen?

Langfristig definitiv. Obwohl eine Anfangsinvestition nötig ist, kostet dich jede Nachricht im Prinzip 0,00 $. Für Unternehmen mit hohem Volumen zahlt sich eine souveräne Lösung meist in 3-6 Monaten aus, indem sie wiederkehrende Abonnementfallen und Vendor Lock-in vermeidet.

Wie liefern Sie das Endprodukt?

Ich stelle einen "Sovereign Container" via Docker bereit. Keine komplizierten Installationen oder Treiberprobleme. Du bekommst ein Ein-Klick-Setup-Skript und eine professionelle README. Führe das Skript aus, und die AI startet in deinem Browser als private, sichere Web-App.

Wirst du mir bei der Ersteinrichtung helfen?

Jedes Paket enthält eine detaillierte Anleitung. Für die Standard- und Premium-Stufen biete ich eine 1-zu-1-Remote-Session an, um deine Umgebung für deine spezifische GPU und VRAM zu optimieren, damit du die höchstmögliche Tokens-pro-Sekunde-Leistung erreichst.