Ich erledige dein Python Web Scraping Scripting

Python-Entwickler

Über diesen Service

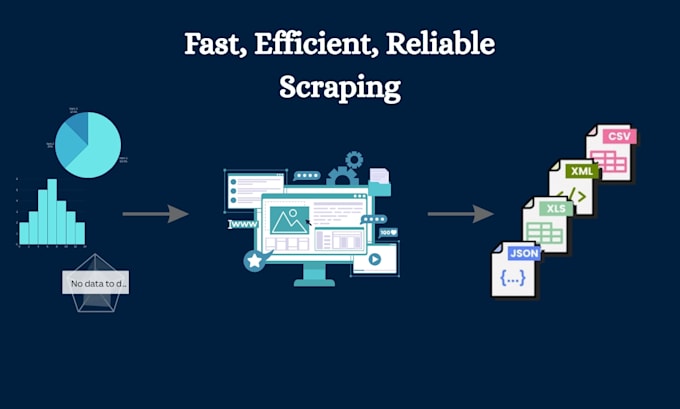

Du brauchst schnelle Datenextraktion? Zuverlässige, leicht zugängliche Daten? Du bist auf dem richtigen Weg. Ich kümmere mich um Data Mining, Datenextraktion, Web Scraping und Web Crawling mit Python: Scrapy, Selenium, Playwright, Requests, BeautifulSoup. Mit schneller Lieferung und einer detaillierten Projektbeschreibung werde ich alle Daten, die du brauchst, scrapen.

Projektablauf

1. Details zu den benötigten Daten angeben, Zielwebseiten, Datentypen und

bevorzugtes Lieferformat spezifizieren.

2. Gründliche Recherche der Seiten und Bestätigung der Scraping-Möglichkeit. Vorschläge werden

erst nach Überprüfung der technischen Machbarkeit des Scrapings gemacht.

3. Sobald die Projektinformationen und Erwartungen vorliegen, werden die Daten genau im vereinbarten Format geliefert.

Verfügbare Formate für die Lieferung:

. CSV

. Excel

. JSON

. XML

. Google Tabellen

100% Zufriedenheit garantiert. Schreib mir, um dein Projekt zu besprechen!

Technologie:

JavaScript

•

Python

•

Beautiful Soup

•

Dramatiker

•

Pandas

Technik:

Automatisiert

Mein Portfolio

FAQ

Automatische Übersetzung

Kannst du mit JavaScript-lastigen oder dynamischen Seiten umgehen?

Ja, ich verwende Tools wie Selenium oder Playwright, um JS-Inhalte vollständig zu rendern und so eine vollständige Datenaufnahme auch von interaktiven Seiten zu gewährleisten.

In welchen Datenformaten lieferst du die Daten?

Standardformate sind CSV, Excel, JSON und XML. Auf Wunsch kann ich auch eine Integration mit Google Sheets, APIs oder Cloud-Speichern wie S3 vornehmen. Alles abhängig vom gewählten Paket. Alle Formate sind für Standard- und Premium-Pakete verfügbar. Das Basic-Paket enthält nur ein CSV-Dokument bei der Lieferung.

Ist das legal und entspricht es den Nutzungsbedingungen der Seiten?

Ich konzentriere mich auf öffentlich zugängliche Daten und respektiere robots.txt, Rate-Limits sowie GDPR/CCPA. Ich werde deine Zielseiten zuerst prüfen, um ethisches Scraping zu bestätigen.

Kannst du groß angelegtes oder geplantes Scraping durchführen?

Absolut – für laufende Bedürfnisse wie tägliche oder wöchentliche Updates richte ich automatisierte Skripte mit Überwachung und Benachrichtigungen ein.

Wie läuft dein Prozess für individuelle Projekte ab?

Wir besprechen die Anforderungen per Nachricht, ich erstelle einen Test-Scraper, liefere eine Beispiel-Datenmenge und skaliere dann auf die vollständige Lieferung inklusive Revisionen.

Wie stellen Sie die Genauigkeit und Qualität der Daten sicher?

Jeder Scrape beinhaltet Validierungschecks auf Duplikate, fehlende Felder und Formatierung. Ich liefere zuerst eine Probe zur Freigabe.